Indice

Una transizione che non possiamo ignorare

Per anni abbiamo progettato il web come un ecosistema di spazi, pagine, interfacce. Oggi quelle stesse interfacce stanno scomparendo davanti a una nuova realtà: quella delle applicazioni integrate direttamente nell’intelligenza artificiale.

OpenAI ha presentato l’App SDK, un kit di sviluppo che permette di costruire vere e proprie applicazioni “dentro” ChatGPT. Niente browser, niente navigazione tradizionale. Solo conversazione, dati e interazione immediata.

È un passaggio epocale. Perché se il web è nato per connettere documenti, questo nuovo modello connette esperienze. Il codice non serve più a creare pagine ma a costruire relazioni digitali. E ogni interazione diventa un progetto di design in tempo reale.

La domanda, oggi, non è più come comunichiamo sul web, ma quanto il web sarà ancora il luogo dove avviene la comunicazione digitale.

Dal browser all’esperienza integrata

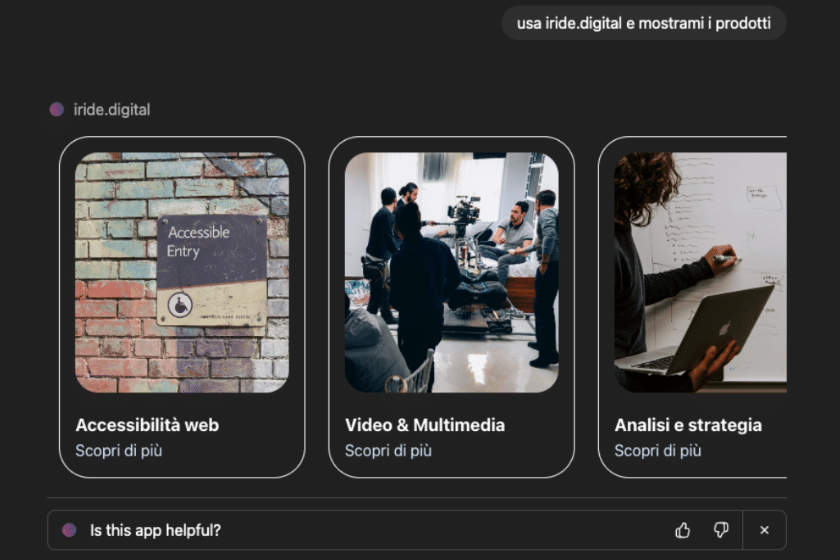

Con l’App SDK di OpenAI, un’azienda può sviluppare un server MCP in Python o Node.js, registrare i propri tool e mostrare contenuti HTML dinamici direttamente all’interno di ChatGPT.

È un sistema capace di dialogare con l’utente, leggere dati, restituire risultati, e perfino aggiornare una UI React in tempo reale. Tutto senza mai aprire una finestra del browser.

Secondo McKinsey Digital (2024), oltre l’80% delle interazioni digitali globali avviene ormai in ambienti chiusi o semi-chiusi — app, chatbot, ecosistemi proprietari. Il browser è diventato un passaggio, non una destinazione.

L’SDK accelera questa transizione, trasformando l’AI in una nuova piattaforma operativa.

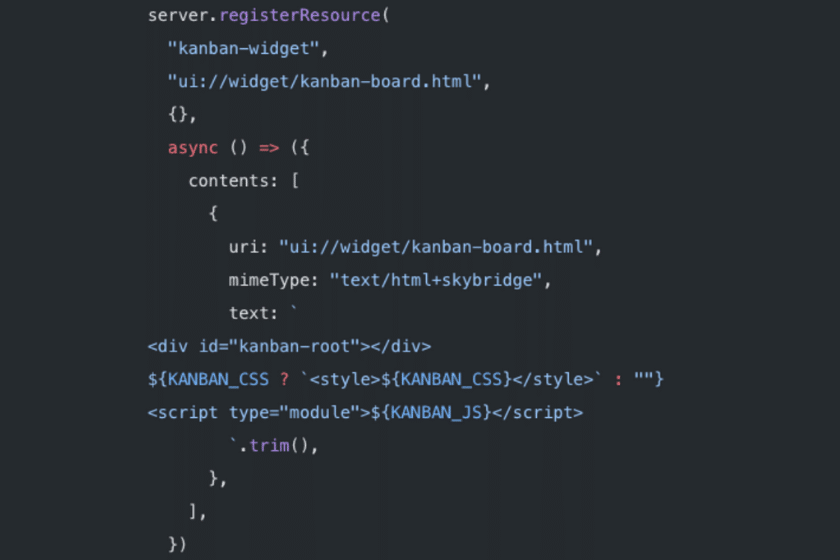

Il primo passo è definire un server MCP, ovvero uno script Node.js o Python, che integra la libreria ufficiale del protocollo e che permette la gestione delle richieste in entrata, la registrazione dei tool disponibili e delle UI.

Per le aziende, significa poter offrire esperienze immediate, con meno attrito e più precisione. Per i designer, vuol dire ripensare completamente il concetto di interfaccia: non si progetta più una home page, ma un contesto interattivo capace di mutare secondo la richiesta dell’utente.

Leggi come lavoriamo sulla progettazione di esperienze digitali.

Risorse HTML integrate direttamente nella chat

Una volta definito il server, arriva la parte più interessante: la registrazione delle risorse HTML che ChatGPT renderizzerà all’interno della conversazione.

Queste risorse usano un mime type particolare, text/html+skybridge, che permette al modello di riconoscere la struttura della UI e popolare i dati nel modo corretto.

L’HTML inviato dal server viene poi integrato con uno script ReactJS e inserito con un iframe all’interno della conversazione con l’utente.

È così che nascono interfacce dinamiche visibili direttamente in chat, senza l’apertura di alcuna finestra esterna.

La conversazione diventa l’interfaccia.

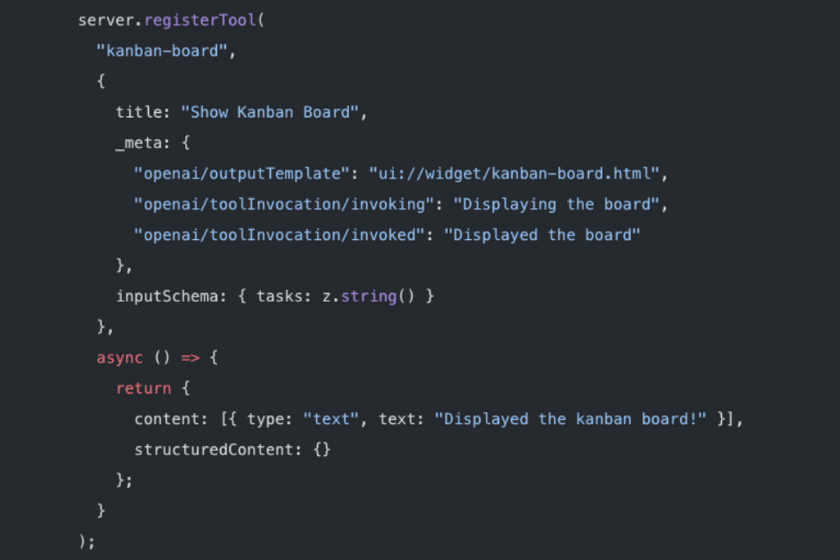

I tool

Se la risorsa definisce come qualcosa deve apparire, il tool definisce cosa deve succedere.

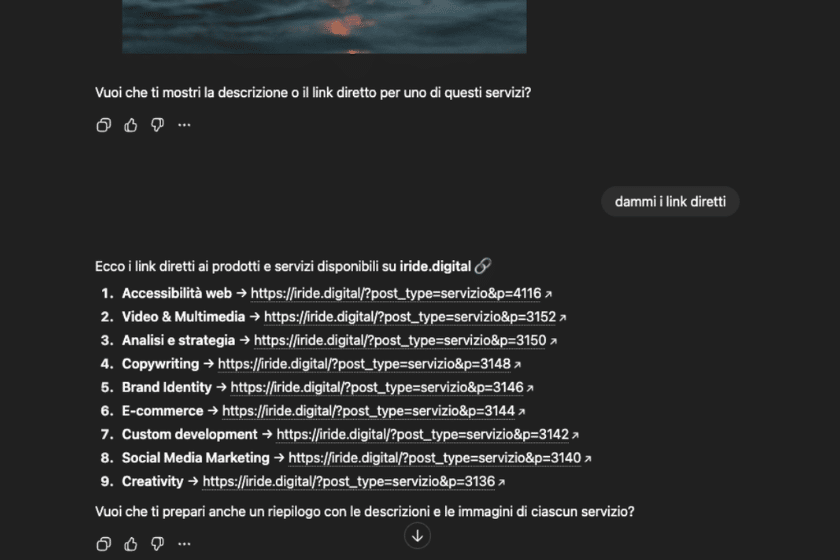

Ogni tool è una funzione lato server che l’AI può invocare in autonomia: può leggere dati, elaborarli, restituirli come content e come structuredContent. Il modello decide poi come interpretarli: elenco, spiegazione, sintesi, tabella.

Questa separazione tra struttura e funzione è ciò che rende l’SDK estremamente flessibile.

Il modello riceve i dati puri e può adattarli al contesto della conversazione.

Come ChatGPT interpreta i dati strutturati

Ogni tool è una funzione lato server che l’AI può invocare in autonomia: può leggere dati, elaborarli, restituirli come content e come structuredContent. Il modello decide poi come interpretarli: elenco, spiegazione, sintesi, tabella.

L’SDK mette a disposizione anche oggetti JS attraverso la window.openai API in modo da rendere interattiva la view del chatbot con l’applicazione React.

Permette ad esempio di gestire lo state interno basandosi su impostazioni della chat, autenticare l’utente, navigare tra pagine, ecc.

Esempi di implementazione completa dello stack: https://github.com/openai/openai-apps-sdk-examples/tree/main/src

Interfacce React che dialogano con la chat

L’SDK fornisce anche un’API JavaScript integrata in window.openai, che permette alla UI di interagire con la conversazione. La view può leggere lo stato della chat, autenticare l’utente, cambiare pagina, aggiornare componenti.

È un modello che supera la distinzione tradizionale tra front-end, back-end e chatbot. Tutto diventa un unico spazio operativo.

Esempi completi sono disponibili nel repository ufficiale: https://github.com/openai/openai-apps-sdk-examples/tree/main/src

Le prime criticità reali

La prima vera difficoltà che si incontra lavorando con l’App SDK è lo sviluppo in locale.

È possibile esporre un server locale tramite strumenti di tunneling come ngrok o Cloudflare Tunnel, ma la gestione corretta di risorse HTML, CSS e JavaScript resta complessa. Le policy di sicurezza del browser e del tunnel interferiscono con il caricamento degli asset, rendendo la fase di sviluppo meno lineare di quanto dovrebbe essere.

Un altro punto ancora poco chiaro riguarda la gestione dell’autenticazione: al momento non esiste una procedura documentata e stabile per autenticare in modo sicuro le richieste verso il server MCP, e questo limita alcune integrazioni più avanzate.

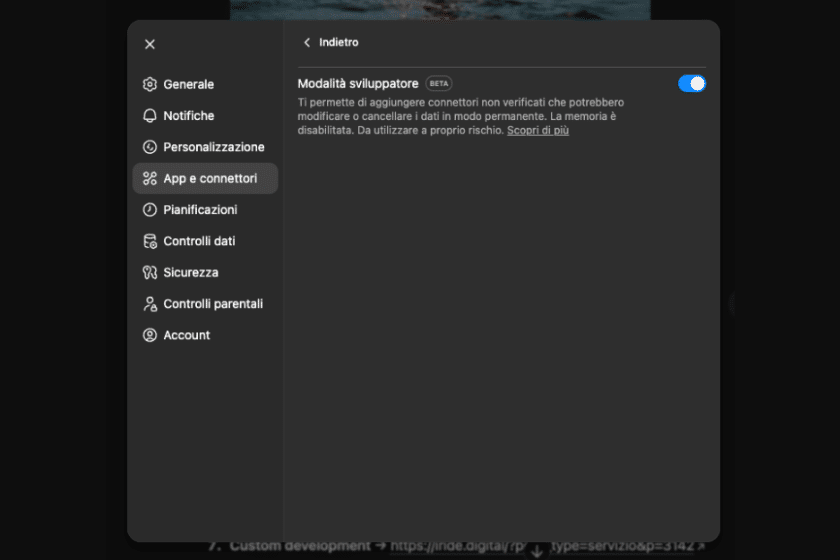

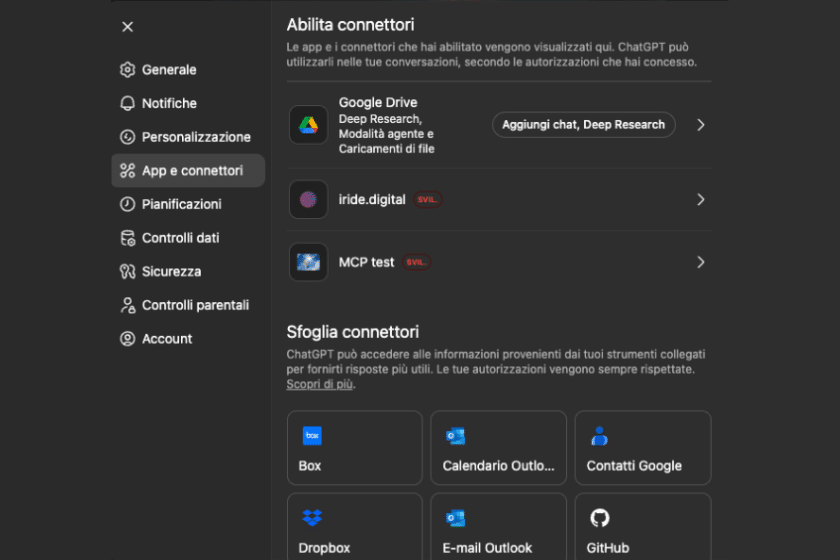

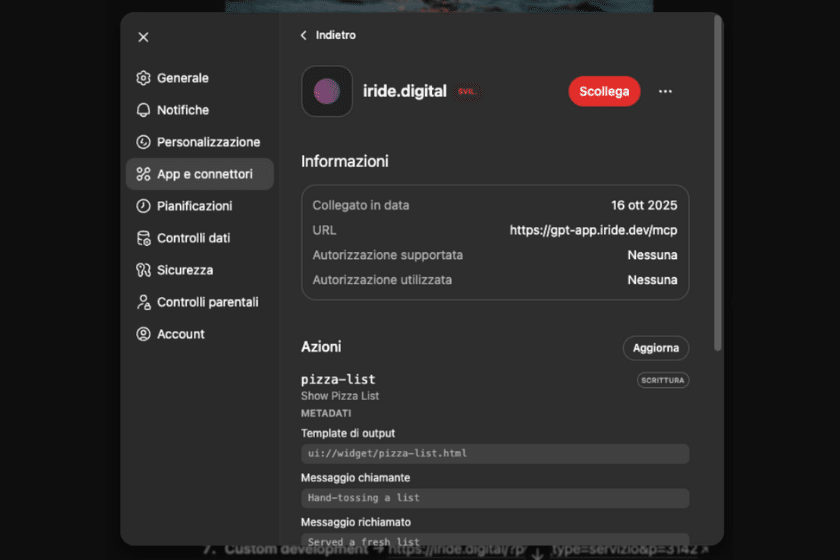

A questo si aggiunge il fatto che le applicazioni non possono ancora essere pubblicate. La fase di review e distribuzione ufficiale arriverà più avanti nel corso dell’anno. Oggi è possibile registrare app personalizzate solo in modalità sviluppatore, all’interno di un account ChatGPT Plus o superiore.

Modalità Sviluppatore

Il design che non si vede

Quando si osservano le app integrate in ChatGPT, la prima impressione è che manchi la UI.

Niente header, niente menu, niente card.

In realtà il design non sparisce: diventa invisibile.

L’utente non “naviga”, ma conversa. E ogni scambio produce una micro-esperienza personalizzata, fatta di dati, contenuti e suggerimenti generativi.

Il Nielsen Norman Group rileva che i flussi conversazionali generano un coinvolgimento cognitivo superiore del 40% rispetto alla navigazione statica. La UX smette di essere una sequenza di pagine e diventa un sistema adattivo che risponde al tono, al ritmo e all’intento dell’utente.

Per chi progetta, significa passare dal wireframe alla semantica.

Serve una nuova grammatica del design, dove il testo, la logica e i dati sostituiscono pulsanti e menu.

Il visual rimane, ma vive dentro un’architettura invisibile che l’utente percepisce più che vedere. È la UX cognitiva, dove ogni scelta è progettata per diminuire lo sforzo mentale e aumentare la fiducia.

Scopri come uniamo design e performance nei nostri progetti digitali.

I brand devono diventare interrogabili

Quando il browser non è più il punto di accesso, cambia il modo in cui gli utenti scoprono un brand.

La scoperta non passa più da SERP, landing page o funnel, ma avviene dentro i modelli AI.

La SEO non sparisce.

Diventa ottimizzazione dei dati per i modelli linguistici.

Significa rendere leggibili le informazioni da una macchina, non solo da un motore di ricerca.

Significa API accessibili, contenuti strutturati, microcopy consistenti.

Secondo il Baymard Institute, il 70% delle aziende digitali che investono in architetture dati orientate all’esperienza (schema, microcopy e UX writing adattivo) registra un aumento del 25% nelle interazioni positive con l’utente.

I brand che sapranno progettarsi come piattaforme, e non solo come siti, saranno quelli che continueranno a esistere in questo nuovo ecosistema.

Non basterà “essere online”. Bisognerà essere interrogabili, interoperabili e intelligenti.

Per approfondire come evolvere la tua presenza digitale, visita la sezione Experience Design.

Il web non è finito. È diventato trasparente

La domanda ricorrente è se questo scenario segni la fine del web.

La risposta è no.

Il web non scompare: si dissolve nel flusso delle esperienze.

Il browser non muore, ma diventa un passaggio.

L’AI ingloba il web e lo redistribuisce in modo più fluido.

Le interazioni non avvengono più necessariamente nel luogo che abbiamo progettato, ma ovunque l’utente si trovi, anche dentro un modello AI.

Lavorare nel digitale significa progettare interazioni che esistono senza essere viste, che vivono nel linguaggio delle persone, nei loro contesti e nei loro strumenti quotidiani.

È qui che il design farà davvero la differenza.

Se vuoi capire come portare la tua presenza digitale dentro l’era delle interfacce AI, contattaci qui.

Articolo a cura di Manfredi Annibaldis, Co-founder e CTO di Iride

Fonti: McKinsey Digital 2024, Nielsen Norman Group, Baymard Institute.